サム・オルトマンの24時間:ペンタゴンは2回「いいえ」と言いましたが、本当に1人に対してだけです

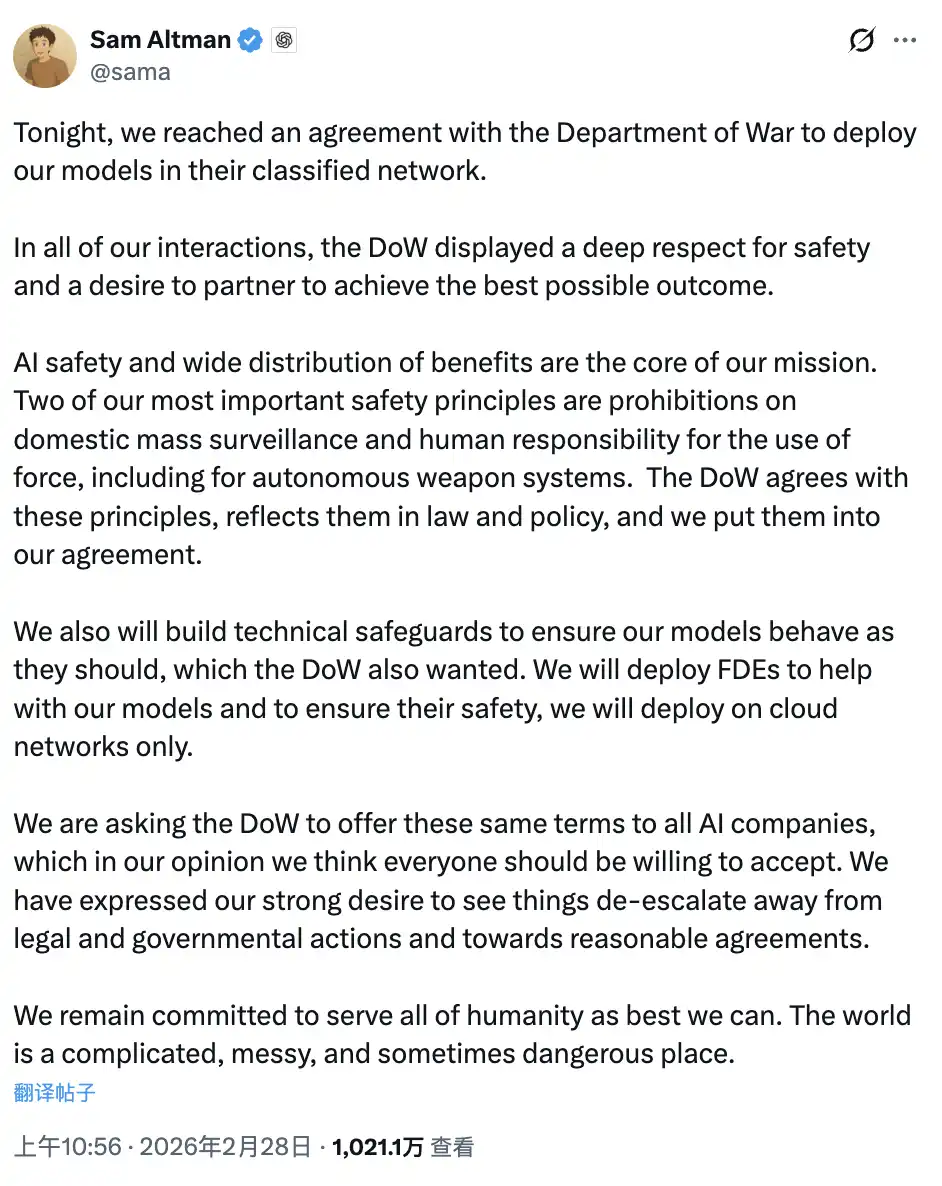

2 月 28 日(北京时间)の午前、Sam Altman は次のツイートを投稿しました。「今晩、米陸軍と協定を結び、当社のモデルを彼らの機密ネットワークに展開することになりました。」

約 12 時間前に時間を巻き戻し、2 月 27 日の夜(北京時間)。同じ彼が CNBC の Squawk Box プログラムの前に座り、落ち着いた口調で述べた言葉は次のようでした。「Anthropic については、多くの意見の相違がありますが、私は基本的にこの企業を信頼しています。彼らは本当にセキュリティを重視していると思います。」彼はまた、「五角大臣はこれらの企業を《国防生産法》で脅迫すべきだとは思いません。」と述べました。

12 時間も経たずに、同じ口から前後不一致の発言。その間に何が起こったのか、ゆっくりと明らかにする価値のあることです。

似たような条項、異なる結果の2つの契約

まずは2つの契約の中心的な内容を並べてみましょう。

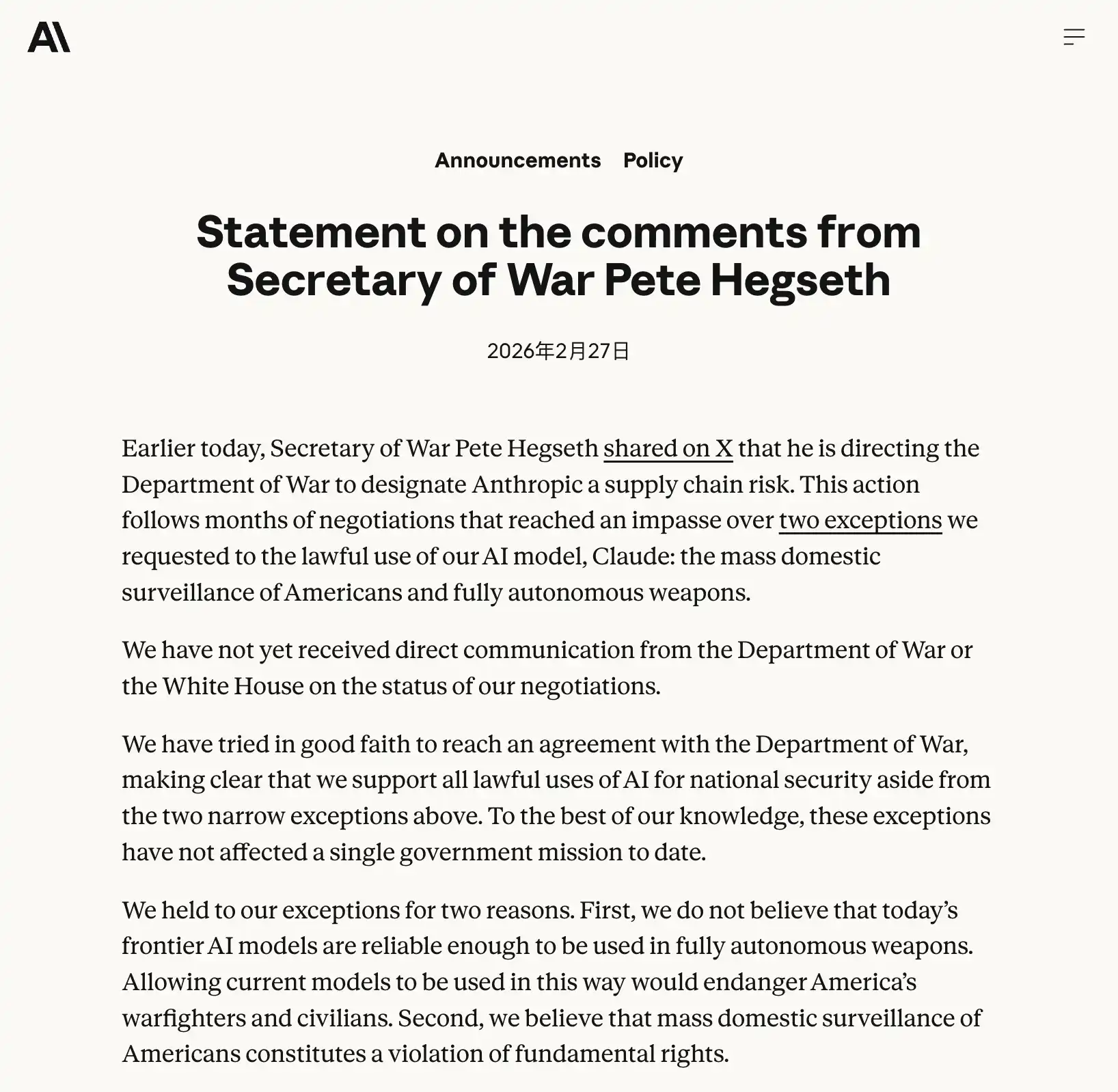

Anthropic の要求:Claude を大規模な米国市民の監視や人間介入のない自律兵器システムに使用しないこと。

Altman が契約を発表した際に引用した2つの同じ原則は以下の通りです。「私たちは長い間、AI が大規模な監視や自律的な致命的兵器に使用されるべきではないと信じており、高リスクな自動化決定において人間は常に立ち会うべきだと考えています。」彼はさらに、「五角大臣はこれらの原則に同意し、それらを法律と政策に反映し、私たちはそれらを契約に取り込んでいます。」と述べました。

文言はほぼ完全に同じです。

1社は禁止され、 「サプライチェーンリスク」 として指定され、トランプ氏自らが Truth Social で 「急進左派の目覚める企業」と非難した。もう1社は契約を獲得し、五角大臣の機密ネットワークに参入しました。Sam Altman はツイートで 「合意に達した」という言葉を使用しました - 冷静でビジネスライクで、まるで普通の B2B 取引が完了したかのように。

この記事全体が答えるべき問いは次のとおりです:似た条件であるにもかかわらず、なぜ結果がまったく異なるのでしょうか?

答えは条項自体ではなく、その背後の論理にあります。

最初には1つの背景事実を明確にしておきます:Anthropic は(他の3社は OpenAI、Google、xAI)の中で唯一、AI を五角大臣の機密ネットワークに接続することが許可されている企業でした。OpenAI の元の契約は非機密の通常の業務にのみ適用されていました。この交渉は、基本的に OpenAI が機密ネットワークに参入したいという点で、そして五角大臣が提示した入場条件が、議論の的となっていた「すべての適法な目的」 条項であった点に関して展開されました。Anthropic は既に中に入っていましたが、五角大臣は、その時点での彼らのセキュリティゲートを解体することを要求しました。

ペンタゴンは書かれた内容よりも誰が発言したかに関心を持っている

この問題を理解するには、まずAnthropicのDario Amodeiがその公開状で実際に何を言ったのかを理解する必要があります。

彼はこう書いています。「Anthropicは、軍事上の意思決定は私企業ではなく、ペンタゴンによって行われることを理解しています。私たちは決して特定の軍事行動に異議を唱えたり、技術の使用を一時的に制限しようとしたことはありません。」

その後、彼はこう続けました。「しかし、極めてまれな場合に、AIが民主主義的価値観を守るのではなく破壊する可能性があると考えています。脅威が私たちの立場を変えることはありません:私たちは良心に従い、彼らの要求を受け入れることはできません。」

この文は契約言語に翻訳すると、何を意味しますか?Anthropicは原則を契約条項に固定し、それによって強制します。もし相手が違反した場合、彼らはサービスを継続する権利を拒否できます。

ペンタゴンは何と聞いたのでしょうか?民間企業は、政府の軍隊に対して次のように伝えました。「ごく一部の場合において、あなたの命令を実行しない可能性があります。境界は私が定めます。」

これはどの軍隊にとっても受け入れがたいものです。彼らが大規模な監視を実施したいと思っているわけではなく、むしろ「判断権は誰に帰属するか」という問題自体が、軍事指揮系統の中で最も敏感な神経なのです。軍事調達担当者のJerry McGinnは、軍の請負業者は通常、製品の使用方法や制限事項をペンタゴンに伝える権限を持っていないとズバリ述べています。「そうでなければ、各契約ごとに具体的な使用シナリオについて議論しなければならなくなるため、それは現実的ではありません」。

一方、OpenAIは全く異なる回答をしました。

Altmanはメモで従業員に語り、OpenAIはペンタゴンに自社の「安全スタック」を提案し、技術コントロール、ポリシーフレームワーク、人間による検証から成るAIモデルと実際の使用の間に埋め込まれた、多層的な保護システムを構築することを目指すと説明しました。OpenAIは同時に、セキュリティ許可を持つ研究者を機密ネットワークに配置し、AIの動作を継続的に監視し、モデルをクラウドに展開し、ドローンなどのエッジシステムには組み込まないことを述べています。

つまり、見守りながら、監督して、起こるすべてを見る。問題が発生した場合、我々は共同で責任を負い、説明を求められるのはあなたではありません。

「ルールを固定し、私が実行します」と「私が埋め込み、あなたが監督する」とは、完全に異なる権力関係であり、ペンタゴンは後者のみを受け入れます。

OpenAI が最も得意とすること、ちょうど五角大学が最も望むこと

ここには少し不快な皮肉がはっきりと述べられる必要があります。

OpenAI が五角大学に約束した「技術の透明性」と「継続的監視」は、自身のユーザーに対して既に実践されています。

2025年8月、OpenAI はユーザーのメンタルヘルス危機に関する公式ブログ投稿で、新しい監視メカニズムを割り込んで開示しました:システムがユーザーの「他者への害を計画している」と検出した場合、会話は専用チャネルに転送され、訓練済みの人間監査チームが処理し、状況を法執行機関に報告する権限を与えられています。これは OpenAI が積極的に公開したものですが、メンタルヘルスに焦点を当てた長文の中で穏やかに言及されています。

2026年2月、つまりこの契約締結の直前、OpenAI は広告システムを開始し、プライバシーポリシーを更新し、一つのことを明確にしました:無料および基本有料ユーザーが ChatGPT を使用する際、システムは「会話のコンテキスト分析」を行い、会話のトピックに基づいて関連する広告をユーザーに表示します。たとえば、レシピについて話している場合、配達サービスの広告を見るかもしれません。OpenAI は、会話の内容そのものが広告主に渡されないことを強調していますが、分析はリアルタイムで行われます。広告は2月9日にテストが開始されました。

2025年11月、OpenAI のサードパーティの分析サービスプロバイダーである Mixpanel が侵害を受け、一部の API ユーザーの名前、メールアドレス、おおよその地理的位置、オペレーティングシステム、ブラウザ情報が漏洩しました。OpenAI はその後、Mixpanel との提携を解消し、現在訴訟を起こしています。この事件は主に API 開発者ユーザーに影響を及ぼし、一般の ChatGPT ユーザーに影響を与えるのは、プラットフォームを介してヘルプセンターチケットを提出した一部の人々です。

これは、五角大学に「技術の透明性、継続的監視、起こるすべてのことを見られるようにする」と約束した会社です。

それが最も得意とすることは、他人に中を見せることです。なぜなら、それは自身のユーザーに対する取り扱いに慣れているからです。

Anthropic は規則が利用者を制約すると信じていますが、OpenAI は自社の人間を組み込むことが、どんな条項よりも効果的だと信じています。前者は理想主義的なコンプライアンスのロジックであり、後者はリアリストの影響力のロジックです。五角大学は後者を選択しました。なぜなら、後者がより馴染みがあり、よりコントロールしやすいからです。

この間、何が起こった?

時間をさかのぼって、北京時間で2月28日未明、米国東部時間で2月27日午後5:01。

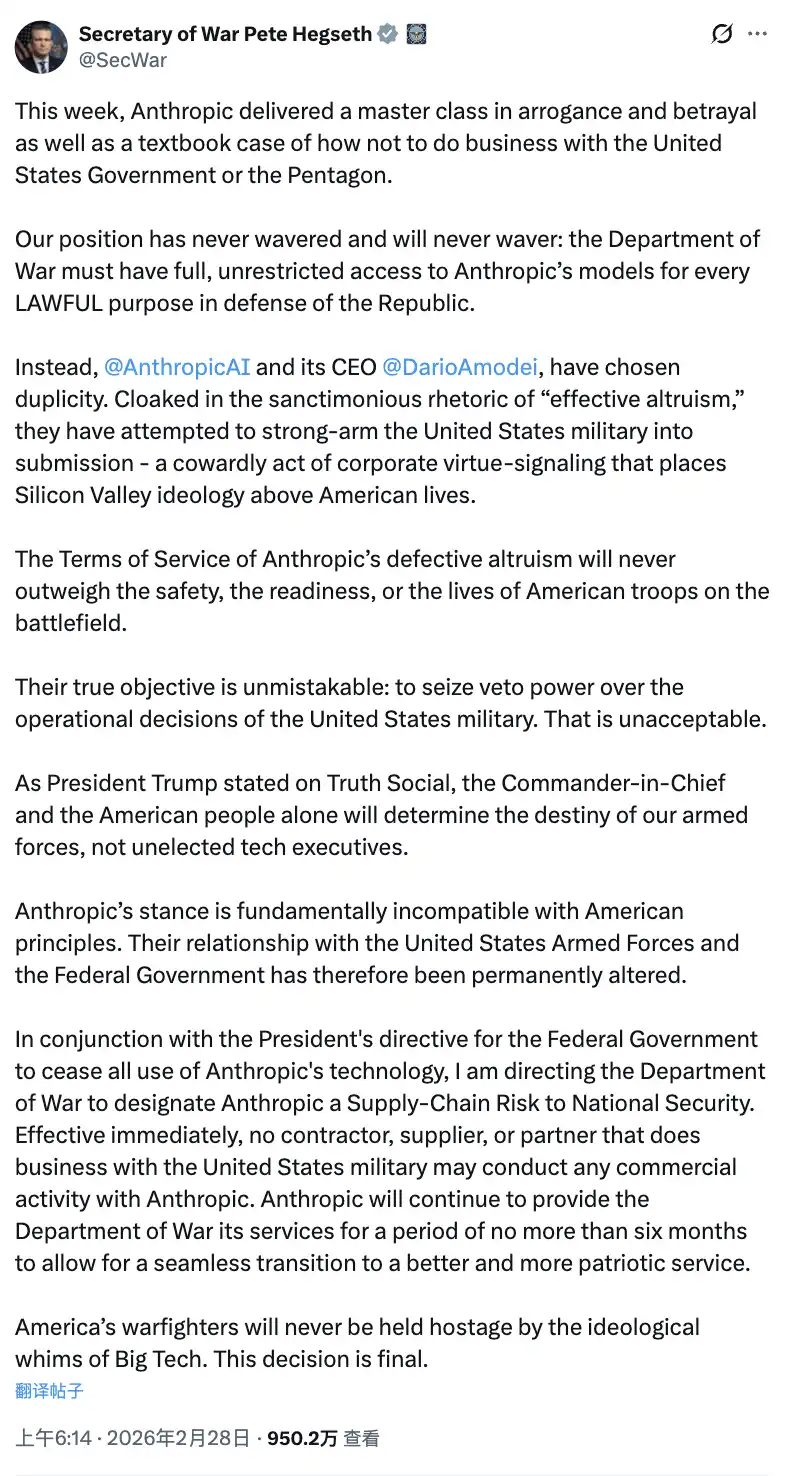

アントロピックの最終締め切りは過ぎました。ダリオは妥協しませんでした。Trump は Truth Social での禁止を発表し、Hegseth は X でアントロピックを「サプライチェーンリスク」としてリストアップしました。アントロピックは法的手段で対処することを発表しました。

Hegseth の声明には注目すべき一文があります。「アントロピックの立場はアメリカの原則と根本的に矛盾しています。」そして、同じ声明の中で、彼はアントロピックが国防総省に「スムーズな移行のために最大6か月間」サービスを提供できると述べています。つまり、彼らは企業を国家安全保障リスクと定義したばかりなのに、まだその企業の製品を使用し続けています。この論理の矛盾について、誰も明確に説明していません。

数時間後、Altman はそのツイートを投稿しました。

彼がその日の全社会で述べたことを振り返ってみましょう:彼は OpenAI が「状況を和らげ、業界全体にフレームワークを提供できる解決策を見つけることを望んでいる」と述べました。これは積極的な待ち手ではありません。

これはシリコンバレーがこの種の行動を初めて目にすることではありません。

2023年、OpenAI の非営利監事会は、「適切なコミュニケーションが欠如している」として Altman を解雇しました。原因は、彼が進捗を速めすぎ、内部コミュニケーションに問題があるとされました。その5日後、Altman は従業員の集団支持の手紙を携えて戻り、監事会は解散しました。その後、彼は企業を非営利組織の構造から営利団体に再編し、会社に制約をかけていた非営利のミッションが新しい法的枠組みに盛り込まれました。

今回、それは「共通の枠組みを見つける」と呼ばれています。

Dario が失ったものは何ですか?

Jerry McGinn 氏、米国戦略国際研究センター産業基盤研究センター長は、この出来事について冷静な見解を示しました。「これはアントロピックにとって絶好のパブリシティであり、彼らは実際 20億ドルを必要としていません。」

この判断は財務的に正確です。アントロピックは2025年に140億ドルの年間収益、3800億ドルの企業価値を達成し、最大の株主であるアマゾンは政府の禁止令によって再投資の論理を再考することはありません。法的手段は転機をもたらすかもしれません。IPO の企業価値は実質的な損害を受けない可能性が高く、「政府の圧力に抵抗し、安全原則を堅持する」という物語は、おそらくどのような広報予算でも同等の効果を買うことはできません。

しかし、1つだけ、Dario は負けました。

軍事領域における AI の実際の使用基準は、Anthropic ではなく、ペンタゴン内で OpenAI によって策定されます。その機密ネットワークに組み込まれた safety stack、セキュリティ許可を保持している OpenAI の研究者たち、AI の行動を継続的に追跡するモニタリングシステム。これらは、今後数年で業界標準として確立されていくでしょう。

Anthropic は原則に忠実で立場を守ったため、規則策定プロセスから排除されました。

そしてその席に座ったのは、わずか12時間以内に「支援」から「署名」へと移行を達成した同じ人物でした。

最も皮肉なのは:AI の安全性を最も真剣に考えていた企業が、AI の安全性を最も真剣に考える場所から追放されたことです。

その席に就いた企業は、ユーザーの会話トピックを広告システムに取り込むメカニズムをたった2週間前にリリースし、3か月前に第三者データ漏洩を経験し、さらに以前にはユーザーを当局に通報するための会話スキャンシステムをこっそりと発表していました。

シリコンバレーでは、Altman の12時間未満の行動には名前があります。それは裏切りと呼ばれるのではなく、タイミングと呼ばれます。

BlockBeats の公式コミュニティに参加しよう:

Telegram 公式チャンネル:https://t.me/theblockbeats

Telegram 交流グループ:https://t.me/BlockBeats_App

Twitter 公式アカウント:https://twitter.com/BlockBeatsAsia