封鎖解除後、ClaudeはApp Storeのトップにランクイン

土曜日の朝、ウルトラマンは X で内部メールのスクリーンショットを転送しました。

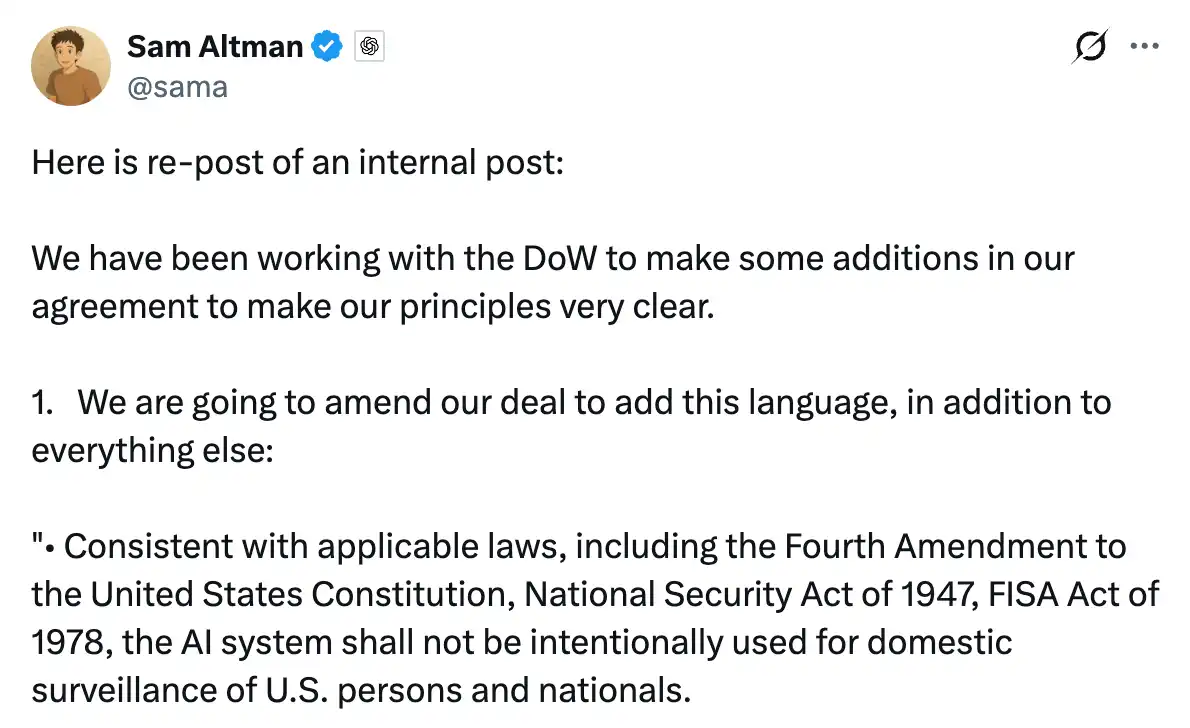

そのメールは、木曜日の夜に OpenAI 社員に宛てて書かれたもので、会社が国防総省と交渉していることを述べ、「状況を緩和する」ことを期待しています。彼はこのメールを転送し、いくつかの説明文を添え、ここ数日何が起こったのかを公開で説明したいと考えています。

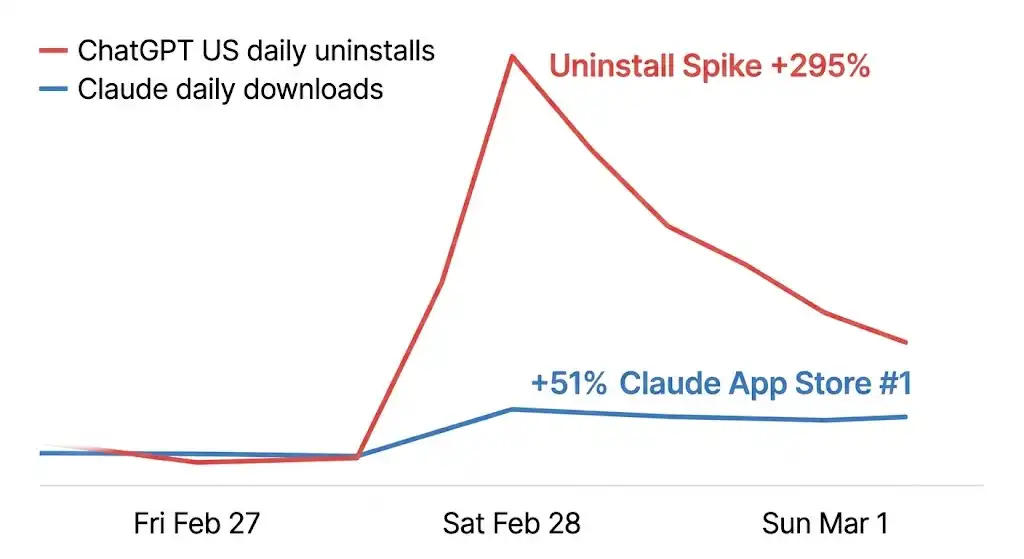

このツイートをした時点で、Claude はすでに米国 App Store の無料トップに躍り出ていました。前日まで、ChatGPT がその位置にいました。

Sensor Tower のデータはその後の数時間を記録しています:土曜日には、ChatGPT の米国でのアンインストール数が通常の 295% 増加し、1 スターレビューが 775% 増加しました。その一方、Claude のダウンロード数は一日で 51% 増加しました。Reddit に「Cancel ChatGPT」(ChatGPT をキャンセル)という投稿の波が現れ、ユーザーがアンサブスクリプションのスクリーンショットを共有し、誰かがコメントで「fastest install of my life」と書いています。QuitGPT.org というサイトが登場し、150 万人が行動を起こしたと主張しています。

月曜日、大量のユーザーが押し寄せたため、Claude は大規模なダウンを起こしました。連邦政府が「サプライチェーンの安全リスク」として指定したその企業は、ユーザーが殺到したことで、サーバーが圧迫されました。

精密な製品対抗

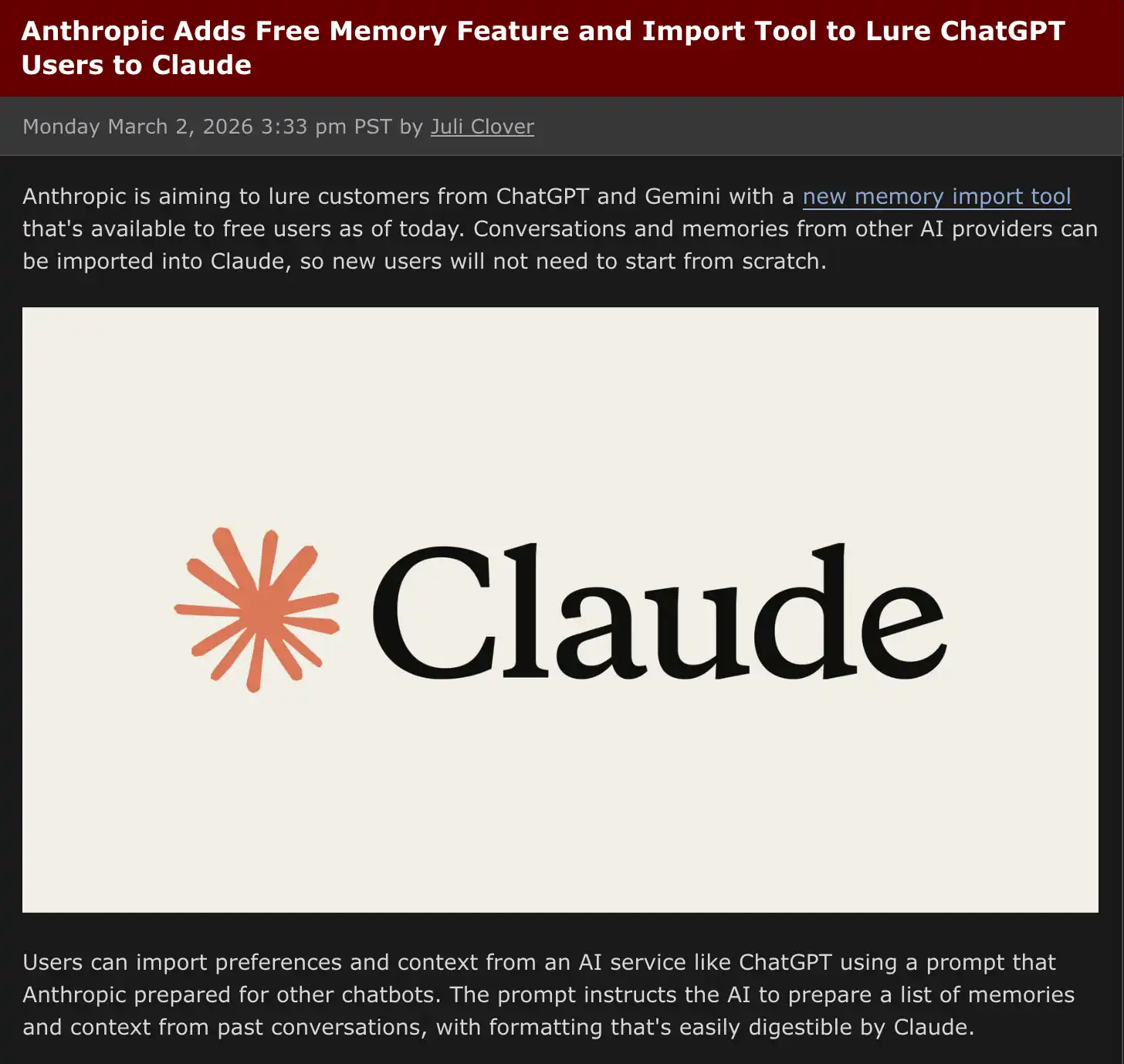

アンソピックは、アンインストールの波が発生したその日に、メモリ転送ツールをリリースしました。

機能自体は複雑ではありません。ユーザーは、チャットGPT に提示ワードをコピーし、そのユーザーのすべての記憶と嗜好を出力するようにし、それを Claude に貼り付け、Claude がすぐにインポートし、チャットGPT を離れたところから続行します。公式ウェブサイトには、たった一文しかありません:「一からやり直すことなく Claude に切り替えます」。

このツールのタイミングは、その最も重要な特性です。

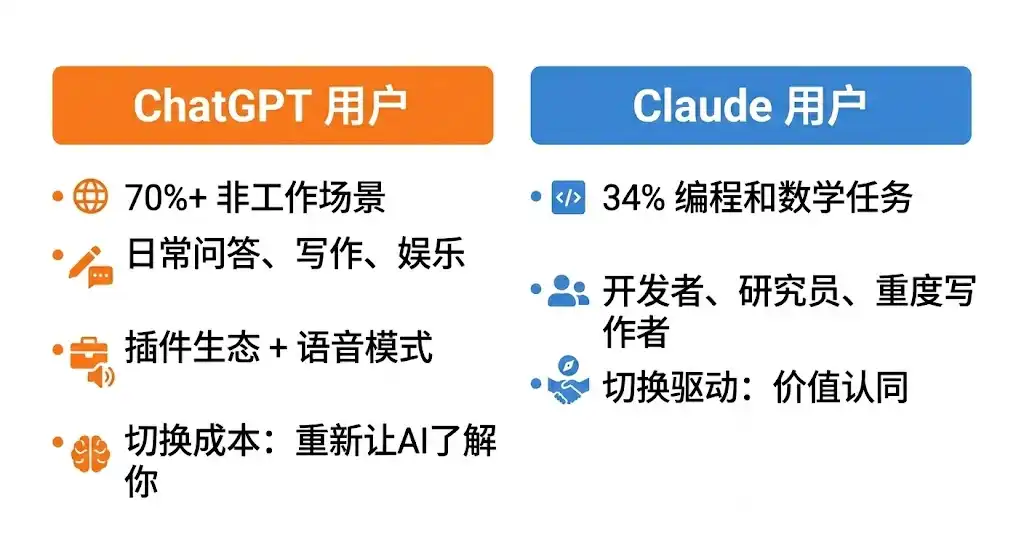

OpenAI 自体のデータによると、2025 年までに、ChatGPT ユーザーの 70% 以上が非作業関連の使用シナリオを持ち、日常的な質問回答、執筆、エンターテインメント、情報検索などが含まれます。それは多くの人にとって初めての AI であり、巨大なプラグインエコシステム、ボイスモード、サードパーティアプリとの深い統合によって日常生活に浸透しています。このようなユーザーの切り替えコストは、「新しいアプリをダウンロードする」だけではなく、あなたが誰であるかを AI に再び理解させることです。記憶の蓄積は、過去に残された最大の理由でした。

Anthropic の独自の調査データによると、Claude の使用シナリオは非常に集中しています。プログラミングおよび数学のタスクが 34% を占め、単一の最大カテゴリです。教育と研究は過去1年で最も急成長している領域です。主要ユーザーは開発者、研究者、およびヘビーライターであり、このグループはより合理的であり、明確な価値判断に基づいてツールを切り替えやすい傾向があります。移行コストが十分に低い限り、ツールを変更することができます。

メモリ移行ツールは、このコストを最小限に抑えました。同時に、Anthropic はメモリ機能を無料ユーザーに完全公開することを発表しました。この機能は以前、有料ユーザー専用でした。

しかし、この急増したユーザーのうち、かなりの割合が元々の Claude のターゲットユーザーではありません。

ソーシャルメディアからのフィードバックによると、ChatGPT から移行してきた一般ユーザーの多くは、初めて Claude を使用した際の反応がしばしば「異なる」となります。誰かは、Claude の回答がより深いと感じ、積極的に反論し、何でもいいとは言いません。誰かは、Claude がライティングにおいてより洗練されていると気づきましたが、画像を生成したり、Voice Mode のような対話体験を提供したりしません。

誰かは本来、「従順な ChatGPT 代替品」を探していたのですが、Claude の個性が強く、適応に時間がかかると気づきました。TechRadar の移行ガイドはこの数日間で大量に共有され、タイトルは「最初にこれらのことを知っていればよかった」となっており、記事の核心メッセージは、Claude と ChatGPT の使用ロジックはまったく異なり、前者はある立場を持つ作業パートナーのようであり、後者は多目的なアシスタントのようである、というものです。

この違いは本来、2つの製品それぞれのポジショニングでしたが、この出来事によって思わぬほど拡大されました。ユーザーは道徳的立場から Claude に押し寄せ、それから彼らの期待とは異なる製品、より慎重で境界を持つ AI を発見しました。これは本来、離脱の理由であったかもしれませんが、この特別な時点で、それは逆に残留の理由となりました:企業の立場を信頼すると、その製品のロジックをより受け入れやすくなります。

公開数日後、Anthropic はデータを公表しました:無料アクティブユーザーは1月比で60%以上増加し、1日当たりの新規登録数は4倍になりました。Claude はアクセスが集中しすぎて一時的にダウンし、数千人のユーザーがログインできないと報告し、数時間で修復されました。

契約書の中の三つの言葉:OpenAI の言葉と行動

Anthropic は、初めて AI モデルを米国国防総省の機密ネットワークに展開した商業企業であり、その協力には Palantir を介して約2億ドルの価値のある契約が含まれています。しかし、過去数ヶ月間、両者の関係は続く悪化を続けています。論争の中心には1つの条項があります:Pentagon は AI モデルを「すべての合法的な目的」に公開するよう要求し、条件を付けないよう求めています。一方、Anthropic は、大規模な米国市民の監視および完全自律武器システムには使用できないという2つの例外を明記することを主張しています。

2月20日前後、報道によると、Anthropicの幹部が1月のアメリカ軍によるベネズエラ大統領マドゥロ逮捕作戦でClaudeの使用方法について、協力企業Palantirに照会し、軍当局が強く不満を表明した。木曜日、ペンタゴンは最後通告を下し、ダリオ・アモデイには当日午後5時までに回答を出すように求めた。

締め切り前に、アモデイは声明を発表し、現行の条件を受け入れられないと述べ、「軍事利用に反対しているわけではなく、AIが民主的価値を守るのではなく破壊する可能性があると信じている場合がある」と述べた。トランプはすぐに、連邦機関がAnthropic製品を6か月以内に全面的に停止すると発表し、Hegsethはこれを「サプライチェーンの安全リスク」として挙げ、このタグは通常、外国の競合他社に使用される。契約はこれで終了した。

空いたポジションにはすぐに誰かが入った。同じ日の後半に、OpenAIがペンタゴンと契約を締結したと発表した。オーテマンは木曜日の社内通達で、立場ははっきりしており、これは「業界全体の問題である」と述べ、OpenAIとAnthropicが同じ「赤い線」を持っているとし、「大規模監視や自律兵器に反対している」と述べた。金曜日には契約が成立し、モデルを軍の機密ネットワークに展開し、クラウド上でのみ実行できるよう制限し、エンジニアを配置して監視し、同じ2つの制限を契約書に記載したと述べた。

その後、オーテマンはXで質問を受け付け、数時間にわたって回答した。誰かが尋ねた:「なぜペンタゴンがOpenAIを受け入れたのにAnthropicを封じたのですか?」彼の回答は、「Anthropicは、契約での具体的な禁止条項に焦点を当てており、適用可能な法律を引用していないようですが、私たちは法律の引用に満足しています」と述べた。

この言葉は方法論の違いを表していますが、この問題の実質的な論点を明らかにしました。

Anthropicが決裂した鍵は、ペンタゴンが書き込むことを主張したフレーズです:AIシステムは「all lawful purposes」に使用できる、すなわちすべての合法目的に使用できる。Anthropicが拒否した理由は、このフレーズが国家安全保障の文脈では固定された境界ではないということです。現行法は、多くの面でAIの能力に追いついておらず、そして「合法」の範囲は政府自体の解釈によって決定されます。OpenAIはこのフレーズに署名しましたが、同時に同様の保護について契約で話し合ったと主張しています。

その後、法律の専門家がOpenAIの公開契約条項を分析し、2つの具体的な表現上の問題点を指摘しました。

監視条項には、「制約されていない」監視を目的としたシステムによって米国市民の個人情報が監視されてはならない、と記載されています。民主とテクノロジーセンターの政策担当副社長、Samir Jain氏は、この文言から、「制約された」監視バージョンは許可されていることが示唆されると指摘しました。現行の法的枠組みでは、政府はデータブローカーから合法的に市民の位置履歴、閲覧履歴、および金融データを購入し、AIにこれらのデータを分析させることで、技術的には「違法な監視」には当たらない可能性があります。Amodei氏は後日CBSの取材でこの例を挙げました。

武器条項には、「法律、規制、または部門方針に基づく人間の制御が要求される場合」に自律型兵器に使用することはできない、と記載されています。この制限付き文言は、制約が他の規定で既に人間の制御が要求されている場合にのみ有効となり、制約は完全に既存の方針に依存します。また、ペンタゴンは自社の内部方針をいつでも変更する権限を有しています。法学者のCharles Bullock氏は、契約の武器条項が依存しているのはDoDディレクティブ3000.09であり、このディレクティブは指揮官が「適切な程度の人間の判断を保持する」と要求しており、この「適切な程度」は柔軟に解釈可能な基準です。

OpenAIはこれらの疑問に対する回答として、モデルはクラウドでのみ実行されるため、直接兵器システムに組み込まれる可能性が排除されていると述べています。契約には具体的な法的根拠も記載されており、文字通りの禁止条項よりも制約力があります。なぜなら法律は検証された枠組みであるからです。Amodei氏自身も、「将来その戦いを戦わなければならない場合は戦いますが、明らかにいくつかのリスクに直面することになります。」と述べています。

これはただの妥協と原則堅持の問題ではなく、これは根本的に異なる安全保障哲学の2つの対立です。OpenAIの基準は「違法なことはしない」です。一方、Anthropicの基準は「法的に禁止されていないが、行うべきでないと考えることも行わない」というものです。

この分歧は、OpenAI内部でも溝を残しています。先週、複数のOpenAI従業員がAnthropicの立場を支持し、それをサプライチェーンのリスクとして見なすことに反対する公開書簡に署名しました。アライメント研究者のLeo Gao氏は、企業の契約が十分な保護を提供しているか疑問視しています。OpenAIサンフランシスコオフィスの外の歩道には、チョークで書かれた批判的な落書きが現れました。一方、Anthropicオフィスの外では支持のメッセージが残されています。Amodei氏が数時間にわたるXの質疑に臨んだ際、その質疑の中心は基本的には元々Anthropicの立場を支持していた自社内の人々に向けられていました。

同じ物語の2つの結果

Anthropicは長年、「文明レベルのリスクを防ぐ」という安全保障使命を定義してきました。この使命は、最先端のAIの潜在的な脅威を核兵器などと同等に位置付け、自社をこの防衛ライン上の守護者と位置付けています。この物語は同社のブランドの核心であり、資本市場で信頼を獲得するための方法です。

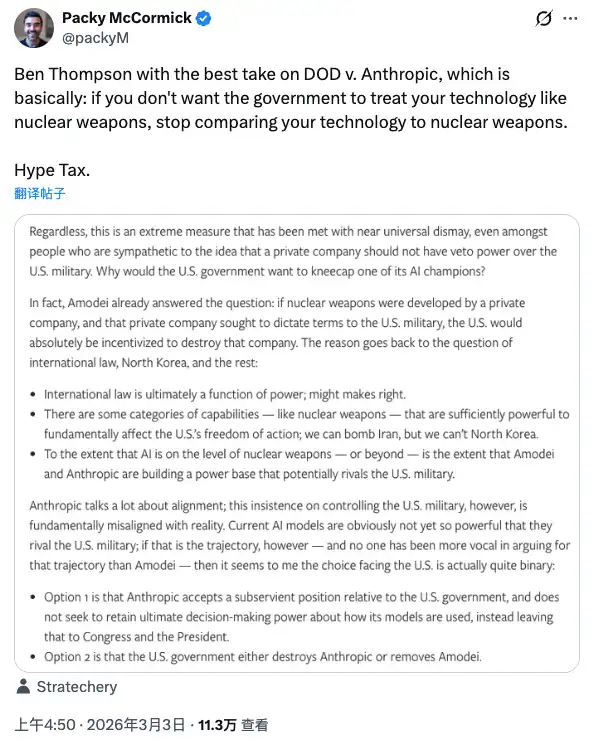

テクノロジー評論家の Packy McCormick は、この出来事の発酵中に、Ben Thompson のコンセプトを引用しました:Hype Tax。つまり、自分の影響力を築くために極端なストーリーテリングを使用すると、そのストーリーが実際の権力と衝突したときにはその代償を支払わなければなりません。AI 技術を核兵器に喩えると、政府は核兵器に対する扱い方であなたに対応します。

Anthropic はこのストーリーに代価を支払いました:契約を失い、セキュリティリスクとされ、大統領に名指しされ、傘下のすべての製品が連邦システムから6ヶ月以内に削除されるよう要求されました。

しかし、同じ週末に、同じストーリーが別の次元でまったく逆の効果を生み出しました。

一般ユーザーが見たものは、契約条件でも、法的解釈でも、セキュリティ哲学の議論でもありません。彼らが見たものは:1つの企業がノーと言い、政府に追い出された。もう1つの企業がイエスと言い、契約を獲得した。彼らは独自の判断枠組みで選択をし、295% のアンインストール率、App Store 1位、サーバーのダウンタイムを生み出しました。

これはAI業界で稀な消費者集団による道徳的立場表明です。

Anthropic はこの問題に一銭もPR予算を費やしていません。Amodei の声明は控えめであり、ユーザー支援を訴えたり、OpenAI を名指ししたり、自己を殉教者として描写することはありませんでした。しかし、結果は生じました。

ここには注目すべき詳細があります:ユーザーが Claude に殺到したイベントは、根本的にはOpenAI が競合他社が禁止され、契約が不透明な状況で契約を締結し、同じ保護条項を付けたと主張したことに起因しています。オートマンは、Anthropic に対するさらなる損害を防ぐために、部分的にこの行動をとったと明言しました。

動機がどうあれ、OpenAI は契約を獲得し、Anthropic のユーザー数が増加しました。両者には代価があり、両者には利益がありますが、単位が異なります。

また、ここで述べるべき重要な点がもう1つあります。

Anthropic が失った五角形の契約は約2億ドルの価値がありました。

Anthropic の現在の年間収益は140億ドルです。2026年までに260億ドルに達することを目標としています。

Anthropicは先月、300億ドルのEラウンド資金調達を完了し、3800億ドルの評価額を達成しました。

この計算は今では難しくありません。しかし、別の答えの出ない問題があります:AIが本当に大規模で軍事意思決定に使用されるようになったとき、契約に明記された「テクノロジーのバリア」と配置されたエンジニアが本当に機能するかどうか、OpenAIやAnthropicが要求していたものに関係なくです。

この問題は、すでに公開されている契約の中には含まれていません。

BlockBeats の公式コミュニティに参加しよう:

Telegram 公式チャンネル:https://t.me/theblockbeats

Telegram 交流グループ:https://t.me/BlockBeats_App

Twitter 公式アカウント:https://twitter.com/BlockBeatsAsia